Digitalt blæst højdepunkt er værre end negativ film, fordi overgangen mellem blæste og lyse områder er ret hård. Slide film er kun lidt bedre end digital i gengivelse af detaljer i overdrevne højdepunkter. Du har ikke engang brug for høj forstørrelse for at se det digitale billede blæse straks almindeligt hvidt, mens den negative film giver mere gradvis falmning af detaljer, og glidefilmen er et sted imellem.

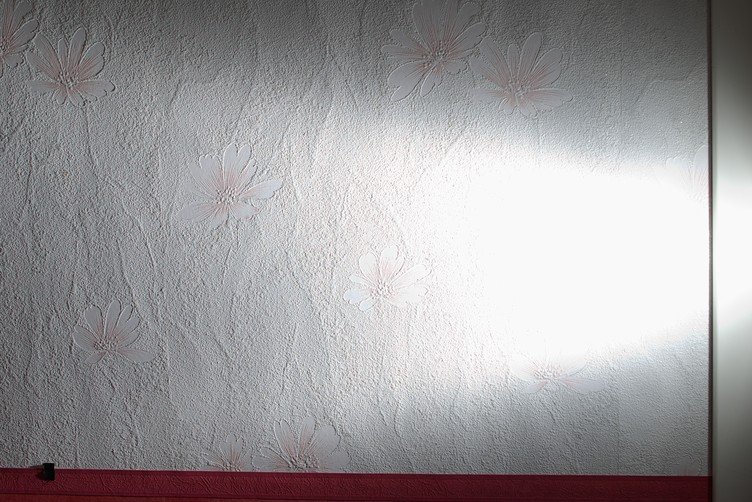

For eksempel er her tapet fra min gang optaget med samme eksponeringsindstillinger og samme linse med digital og negativ film. Film optages på kortere afstand for at matche synsfeltet. Belysning leveres af blitz uden for kameraet i manuel tilstand, der er indstillet på en lysstand lige ved højre side af rammen. Objektivdæksel bruges til at undgå, at lyset fra lyset forsvinder. Flasheffekten blev fordoblet ved optagelse af diasfilm for at kompensere for dens lavere følsomhed.

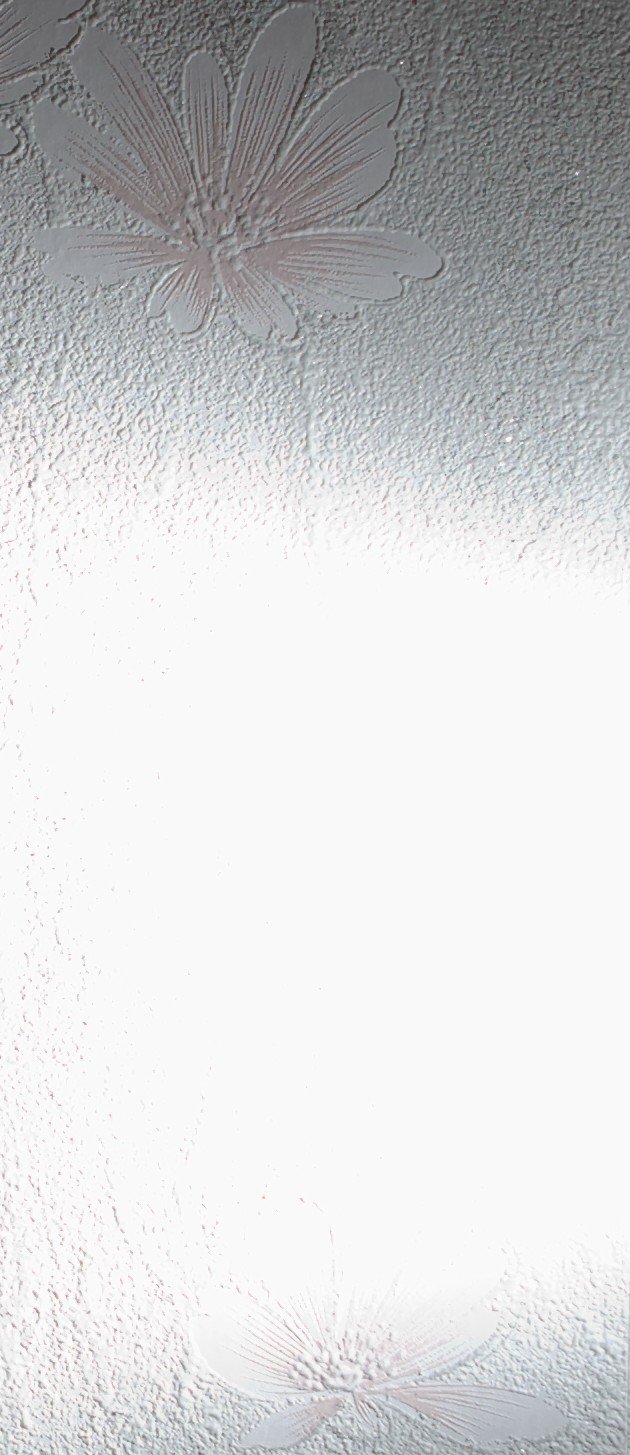

Pentax K100d Super, ISO 200, JPEG, Sigma 28mm f / 1.8 ved f / 5.6 , 1 / 125s, flasheffekt 1/16

Pentax K100d Super, ISO 200, RAW, Sigma 28mm f / 1.8 ved f / 5.6, 1 / 125s, flasheffekt 1/16, behandlet ved -1/2 EV

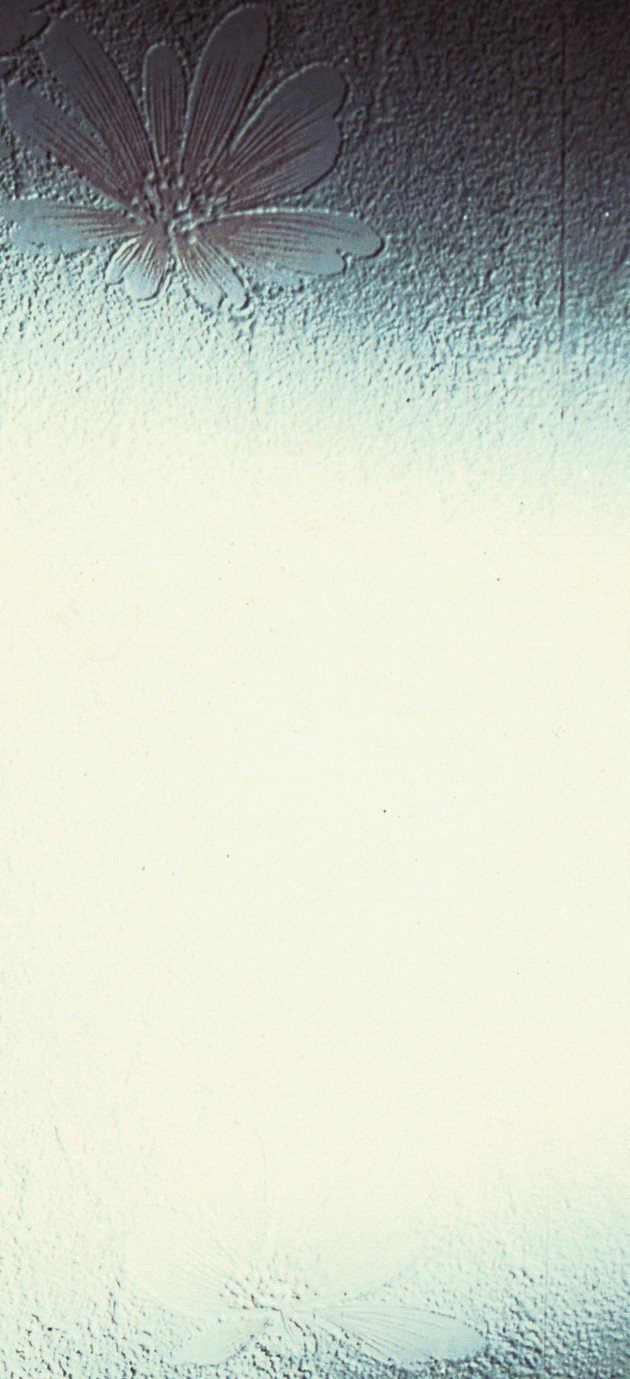

Pentax MZ-6, Fujifilm Superia 200 (negativ), Sigma 28mm f / 1,8 ved f / 5.6, 1 / 125s, flasheffekt 1/16

Pentax MZ-6, Fujifilm Velvia 100 (slide), Sigma 28mm f / 1.8 ved f / 5.6, 1 / 125s, flasheffekt 1/8

Den hvide plet på det digitale billede fanger opmærksomhed og irriterer, mens filmbilledet ligner meget mere det, der kunne ses med lignende sidebelysning. Optagelse i RAW kan hjælpe lidt, men den hvide klipper stadig ret hårdt.

100% afgrøder: